Nota

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare ad accedere o modificare le directory.

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare a modificare le directory.

Importante

Questa funzionalità è in versione beta. Gli amministratori dell'area di lavoro possono controllare l'accesso a questa funzionalità dalla pagina Anteprime . Consultare Gestisci anteprime Azure Databricks.

Mosaic AI Vector Search offre una valutazione di qualità predefinita per il recupero che misura e confronta la pertinenza di diverse strategie di ricerca sui dati. È possibile generare automaticamente query di valutazione dai documenti, eseguire più strategie di recupero e generare un report dettagliato.

Requisiti

Indice di ricerca a vettore per Delta Sync gestito. Vedere Creare endpoint e indici di ricerca vettoriali.

Autorizzazioni

Il dashboard del lavoro di valutazione e dei risultati eredita le autorizzazioni di Unity Catalog dall'indice di ricerca vettoriale. Qualsiasi utente con accesso alle query all'indice può avviare un'esecuzione di valutazione e visualizzare il dashboard dei risultati. L'utente che avvia l'esecuzione di valutazione è il proprietario del processo, non il proprietario dell'indice.

Funzionamento della valutazione della qualità del recupero della ricerca vettoriale

La valutazione esegue una pipeline a quattro fasi sui tuoi dati:

- Genera query: il sistema campiona documenti dalla tua tabella di origine e usa un LLM per generare query di ricerca realistiche. Genera una combinazione di query in linguaggio naturale e query con parole chiave.

- Eseguire ricerche tra strategie: ogni query generata viene eseguita sull'indice usando più strategie di recupero, tra cui ANN, ibrido e full-text. Ogni strategia viene valutata anche con e senza il reranker. Questo approccio confronta le strategie affiancate nello stesso set di query. Per altre informazioni su ogni strategia di recupero, vedere Algoritmi di recupero.

- Pertinenza del punteggio: un giudice LLM valuta ogni query e coppia di documenti recuperati su una scala di pertinenza a 4 punti.

- Metriche di calcolo e analisi: il sistema calcola le metriche di qualità di recupero con intervalli di confidenza. I risultati vengono resi persistenti in modo da poterli visualizzare in un secondo momento o confrontarli tra le esecuzioni di valutazione.

Avviare un processo di valutazione della qualità del recupero

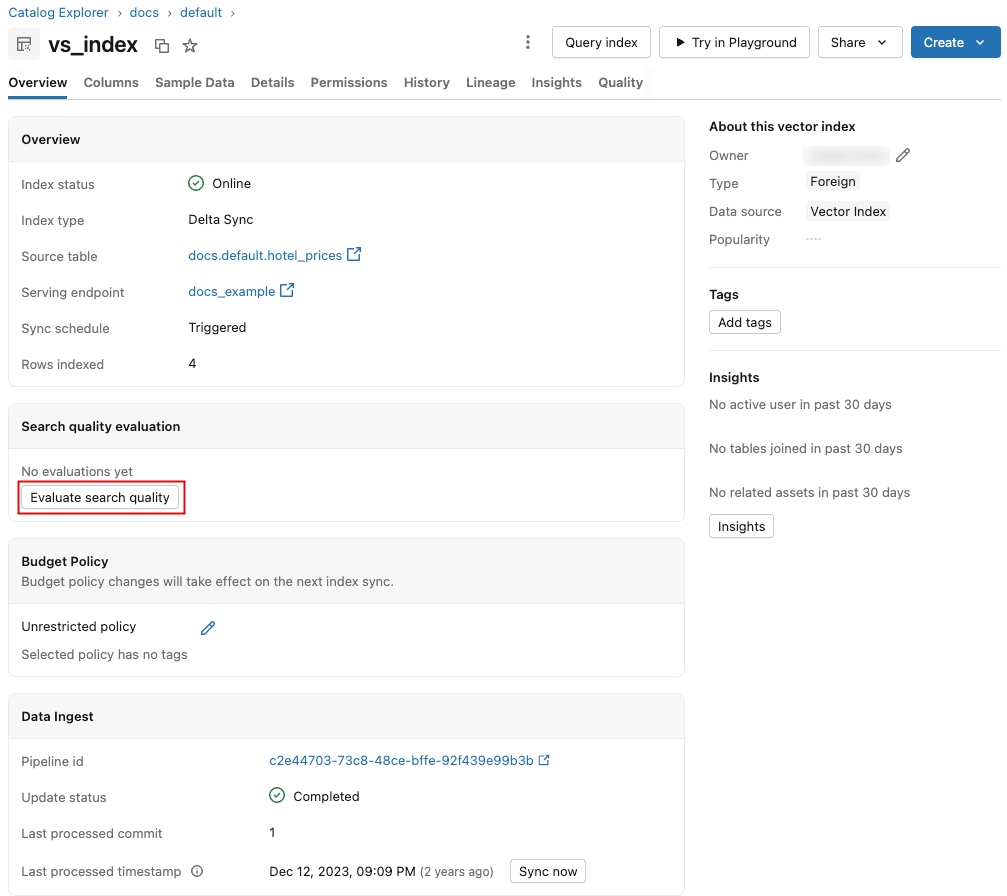

Per avviare il processo, fare clic su Valuta la qualità della ricerca nella pagina dell'indice di ricerca vettoriale. Non è necessaria alcuna configurazione, perché i valori predefiniti vengono pre-popolati in base ai metadati dell'indice.

Al termine dell'esecuzione, fare clic su Visualizza risultati per visualizzare il dashboard dei risultati. Per una panoramica del dashboard, vedere Dashboard dei risultati.

Per avviare una nuova valutazione in qualsiasi momento, fare clic su Avvia nuova valutazione.

Dashboard dei risultati

Il dashboard presenta i risultati delle esecuzioni di valutazione. Usare il menu a discesa Seleziona esegui per selezionare l'esecuzione da visualizzare.

Nella parte superiore del dashboard sono presenti tre indicatori di riepilogo: il punteggio di DCG@10 migliore per tutti i tipi di query, il tipo di query consigliato che lo ha ottenuto e il numero di query valutate.

Vedere Perché Databricks consiglia di DCG@10.

Sotto gli indicatori di riepilogo, il dashboard mostra un grafico a barre che confronta i punteggi DCG@10 per ogni tipo di query, con e senza l'uso del reranker. Accanto al grafico a barre sono presenti due tabelle che mostrano DCG@10 e pertinenza media per ogni tipo di query, con e senza il reranker.

Di seguito è riportato un grafico a linee che mostra come cambia la pertinenza media tra le posizioni dei risultati per ogni tipo di query.

Il dashboard presenta anche le query con prestazioni più elevate e più basse in base al punteggio medio di pertinenza, una tabella che confronta le prestazioni di base e reranker per ogni tipo di query, una tabella di query non riuscite (query in cui il risultato principale-1 è stato segnato 0 (irrilevante)) e un grafico a linee che mostra una metrica selezionata tra le esecuzioni di valutazione nel tempo, in base alla metrica di query.

Assegnazione dei punteggi per pertinenza

La valutazione della qualità del recupero delle informazioni utilizza un "LLM-as-judge" per assegnare un punteggio a ogni coppia di query e documenti recuperati su una scala di pertinenza a quattro livelli.

| Punteggio | Etichetta | Descrizione | Esempio |

|---|---|---|---|

| 3 | Altamente rilevante | Il documento risponde direttamente alla query o fornisce esattamente le informazioni ricercate | Query: "Come si calcola l'area di un rettangolo?" Il documento spiega la formula lunghezza × larghezza |

| 2 | Rilevante | Il documento è correlato e fornisce informazioni utili, ma potrebbe non rispondere completamente alla query | Query: "dove si trova il numero di instradamento su un assegno?" Il documento riporta "stampato sull'assegno in fondo" (parzialmente completo) |

| 1 | Parzialmente rilevante | Il documento menziona l'argomento, ma non fornisce informazioni utili per la query | Query: "Come calcolare l'area di un rettangolo?" Il documento illustra solo l'area dei rettangoli in termini generali |

| 0 | Non rilevante | Il documento non è correlato alla query o il linguaggio del documento non corrisponde al linguaggio di query | Query in inglese Il documento risponde correttamente ma in francese |

Rispetto a una scala binaria rilevante o non rilevante, la scala con classificazione acquisisce importanti distinzioni. Ad esempio, un documento che risponde direttamente a una domanda (punteggio 3) è significativamente diverso da quello che si limita a toccare l'argomento (punteggio 1). Questa granularità passa attraverso le metriche, in particolare DCG, che pesa più pesantemente i risultati di qualità superiore.

Tutte le metriche includono 95% intervalli di confidenza calcolati tra valori per query, in modo da poter valutare se le differenze tra le strategie sono statisticamente significative.

Metriche di recupero

Nella parte inferiore del dashboard è possibile visualizzare una metrica selezionata nel tempo. Selezionare la metrica da visualizzare dal menu a discesa Seleziona metrica .

Questa sezione descrive le metriche disponibili.

DCG@k - Guadagno cumulativo scontato

DCG@10 misura sia quanto i risultati siano pertinenti sia la loro posizione nel posizionamento, utilizzando la scala completa di pertinenza da 0 a 3. Databricks consiglia di usare DCG@10 come metrica principale per valutare la qualità complessiva del recupero.

- Cosa misura: l'utilità totale dei primi 10 risultati, ponderata in base alla posizione. I risultati con classificazione più alta contribuiscono più di quelli con classificazione più bassa.

- Come funziona: il punteggio di pertinenza di ogni risultato viene ponderato da uno sconto logaritmico in base alla sua posizione. Il primo risultato contribuisce alla sua piena rilevanza, mentre i risultati con classificazione inferiore contribuiscono progressivamente meno.

- Intervallo: da 0 al massimo teorico illustrato nella tabella seguente. Più alto è meglio.

Valori massimi teorici di DCG, se ogni risultato riceve un punteggio di 3

| k | DCG massimo teorico |

|---|---|

| 1 | 3.00 |

| 3 | 6.39 |

| 5 | 8,85 |

| 10 | 13.63 |

| 20 | 21.12 |

Per mettere questi numeri in prospettiva: se tutti i 10 risultati hanno una rilevanza pari a 2 (su scala 0-3), DCG@10 è 13,6. In questo scenario, un guadagno di 1 punto DCG@10 è un miglioramento molto significativo (+7% relativo). Puoi pensare a un risultato specifico nella pagina che diventa significativamente migliore, con una maggiore enfasi verso l'alto.

NDCG@k - Guadagno cumulativo scontato normalizzato

- Cosa misura: come vengono ordinati i risultati in relazione all'ordinamento migliore possibile. NDCG normalizza DCG dividendo il DCG ideale (DCG se i risultati sono stati ordinati in ordine decrescente di pertinenza).

- Intervallo: da 0 a 1. Un punteggio di 1,0 indica che i risultati sono in ordine perfetto.

- Quando usare: quando si vuole sapere se il sistema sta classificando correttamente i risultati, indipendentemente dal numero totale di documenti pertinenti disponibili. Per un confronto dettagliato, vedere Perché DCG@10 è la metrica primaria consigliata .

Recall@k

- Cosa misura: la frazione di documenti rilevanti noti che appaiono nei primi k risultati.

- Intervallo: da 0 a 1. Un punteggio pari a 1,0 indica che tutti i documenti rilevanti noti sono stati recuperati.

- Quando usare: quando la completezza è importante, ad esempio nelle applicazioni RAG in cui manca un documento pertinente indica che LLM genera una risposta incompleta.

Precision@k

- Cosa misura: frazione dei risultati top-k rilevanti (punteggio >di pertinenza = 2).

- Intervallo: da 0 a 1. Un punteggio pari a 1,0 indica che ogni risultato nella parte superiore k è rilevante.

- Quando usare: quando la qualità dei risultati è più importante della completezza, ad esempio nelle interfacce di ricerca in cui i risultati irrilevanti potrebbero influire negativamente sull'attendibilità dell'utente.

Punteggio medio di pertinenza

- Cosa misura: punteggio di pertinenza valutato dall'LLM medio in tutte le coppie di query e risultati.

- Intervallo: da 0 a 3. Più alto è meglio.

- Quando usare: come snapshot di qualità rapida.

Distribuzione della pertinenza

-

Cosa misura: la percentuale di risultati in ogni categoria di pertinenza:

- %altamente rilevante : risultati con punteggio 3 (risposte dirette).

- Rilevante+ %: risultati con punteggio 2 o superiore (utile).

- Non rilevante %: risultati con punteggio 0 o 1 (non utile).

- Quando usare: per comprendere la forma della distribuzione della qualità. Due strategie possono avere lo stesso punteggio medio, ma distribuzioni molto diverse. Ad esempio, una distribuzione bimodala (molti 3 e molti 0) potrebbe suggerire che un modello di query non viene recuperato correttamente e richiede attenzione.

MRR — Rango reciproco medio

- Cosa misura: quanto rapidamente gli utenti trovano il primo risultato pertinente. MRR è la media di 1/posizione su tutte le query, dove posizione è quella del primo risultato pertinente (punteggio >= 2).

- Intervallo: da 0 a 1. Un punteggio pari a 1,0 indica che il primo risultato è sempre rilevante.

- Quando usare: quando il risultato principale è più importante, ad esempio nei sistemi di risposta alle domande.

Media della precisione media

- Ciò che misura: la qualità della classificazione in tutti i risultati rilevanti, non solo la prima. MAP calcola la precisione in corrispondenza della posizione di ogni risultato pertinente, quindi calcola le medie.

- Intervallo: da 0 a 1. I valori più alti indicano che i documenti pertinenti vengono classificati in modo coerente nella parte superiore.

- Quando usare: quando è necessario un singolo numero che acquisisce la qualità complessiva della classificazione in tutti i documenti pertinenti.

Perché DCG@10 è la metrica primaria consigliata

DCG@10 offre il quadro più completo della qualità di recupero per la maggior parte delle applicazioni:

- La pertinenza con classificazione acquisisce sfumature: le metriche binarie come la precisione trattano equamente tutti i documenti pertinenti. Un documento che risponde perfettamente alla query (punteggio 3) conta lo stesso di quello che menziona vagamente l'argomento (punteggio 1). DCG usa la scala di pertinenza completa da 0 a 3, quindi un risultato con punteggio 3 contribuisce significativamente più di un risultato con punteggio 1.

- Posizione importante: gli utenti esaminano prima i risultati principali. DCG applica uno sconto logaritmico, in modo che i risultati nella posizione 1 conteggino molto più dei risultati nella posizione 10. Il primo risultato contribuisce con il suo punteggio di pertinenza intero, mentre il contributo del 10° risultato è diviso per log₂(11) ≈ 3,46.

- L'utilità assoluta rivela le metriche normalizzate mancanti: si consideri l'esempio illustrato nella tabella seguente. Entrambi i set di risultati ottengono un NDCG perfetto di 1,00 perché ognuno ha risultati in ordine decrescente ideale. Tuttavia, il set di risultati B offre quasi il doppio del valore totale (DCG 8,02 rispetto a 4,26) perché ogni risultato è utile. NDCG non può distinguere tra "classifica perfetta di 2 buoni risultati tra 3 irrilevanti" e "classifica perfetta di 5 buoni risultati". DCG risponde alla domanda: "Quante informazioni utili hanno effettivamente avuto l'utente?"

Per altre informazioni su DCG e NDCG, vedere Guadagno cumulativo scontato.

| Results | Posizione 1 | Posizione 2 | Posizione 3 | Posizione 4 | Posizione 5 | NDCG@5 | DCG@5 |

|---|---|---|---|---|---|---|---|

| Set di risultati A | 3 | 2 | 0 | 0 | 0 | 1,00 | 4.26 |

| Set di risultati B | 3 | 3 | 3 | 2 | 2 | 1,00 | 8.02 |

Nessuna singola metrica indica tutta la storia. Usare la suite di metriche completa per un'immagine completa e selezionare la metrica più adatta ai requisiti di qualità dell'applicazione.

Scenari comuni

La tabella seguente illustra i modelli di risultato di valutazione comuni, il significato e come risolverli:

| Modello | Significato | Azione suggerita |

|---|---|---|

| Soluzione ibrida significativamente migliore rispetto all'ANN | Le query traggono vantaggio dalla corrispondenza delle parole chiave. | Usare la ricerca ibrida nell'ambiente di produzione. |

| ANN approssimativamente uguale a ibrido | Le parole chiave non aggiungono valore per i dati. | Entrambe le strategie funzionano. ANN è più semplice. |

| Full-text significativamente migliore di ANN | Gli incorporamenti potrebbero non rappresentare adeguatamente il tuo dominio. | È consigliabile ottimizzare il modello di incorporamento o usare la ricerca full-text. |

| Reranker migliora significativamente le metriche | Il cross-encoder fornisce un miglioramento significativo della qualità. | Abilita il reranker se il budget di latenza lo consente. |

| Intervalli di confidenza estesi | Numero di query insufficiente per un confronto affidabile. | Aumentare il numero di query di valutazione. |

| Tutte le strategie ottengono punteggi bassi | Problemi relativi alla qualità dei dati o alla pertinenza. | Per una guida dettagliata al miglioramento della qualità del recupero nella ricerca vettoriale, vedere la guida sulla qualità del recupero della ricerca vettoriale. |