Nota

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare ad accedere o modificare le directory.

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare a modificare le directory.

Importante

La scalabilità automatica di Lakebase è la versione più recente di Lakebase, con calcolo autoscalabile, scalabilità fino a zero, ramificazione e ripristino immediato. Per le aree supportate, vedere Disponibilità dell'area. Se sei un utente provisioning di Lakebase, vedere Lakebase provisioning.

Alla fine di questa guida si avrà un database Postgres in esecuzione con dati di esempio, connessi al catalogo Unity, con flusso di dati tra Lakebase e databricks lakehouse.

Passaggi: (1) Creare un progetto → (2) Connect → (3) Creare una tabella → (4) Registrare in Unity Catalog → (5) Rendere disponibili i dati

Passaggio 1: Creare il primo progetto

Aprire l'app Lakebase dal commutatore delle app.

Selezionare Scalabilità automatica per accedere all'interfaccia utente di scalabilità automatica di Lakebase.

Fare clic su Nuovo progetto. Assegnare un nome al progetto e selezionare la versione di Postgres. Il progetto viene creato con un singolo production ramo, un database predefinito databricks_postgres e risorse di calcolo configurate per il ramo.

L'attivazione del calcolo potrebbe richiedere alcuni istanti. Il calcolo per il production ramo è sempre attivo per impostazione predefinita (la scalabilità a zero è disabilitata), ma è possibile configurare questa impostazione, se necessario.

La regione per il tuo progetto viene impostata automaticamente sulla regione della tua area di lavoro.

Altre informazioni: Crea un progetto | Scalabilità automatica | Scala a zero

Passaggio 2: Connettersi al database

Nel progetto selezionare il ramo di produzione e fare clic su Connetti. Le stringhe di connessione funzionano con qualsiasi client Postgres standard (psql, pgAdmin, DBeaver o un framework di applicazione).

Per connettersi all'identità di Databricks, copiare il psql frammento di codice dalla finestra di dialogo di connessione e incollare il token OAuth quando richiesto:

psql 'postgresql://your-email@databricks.com@ep-abc-123.databricks.com/databricks_postgres?sslmode=require'

Altre informazioni: Connessione – Avvio rapido | | |

Passaggio 3: Creare la prima tabella

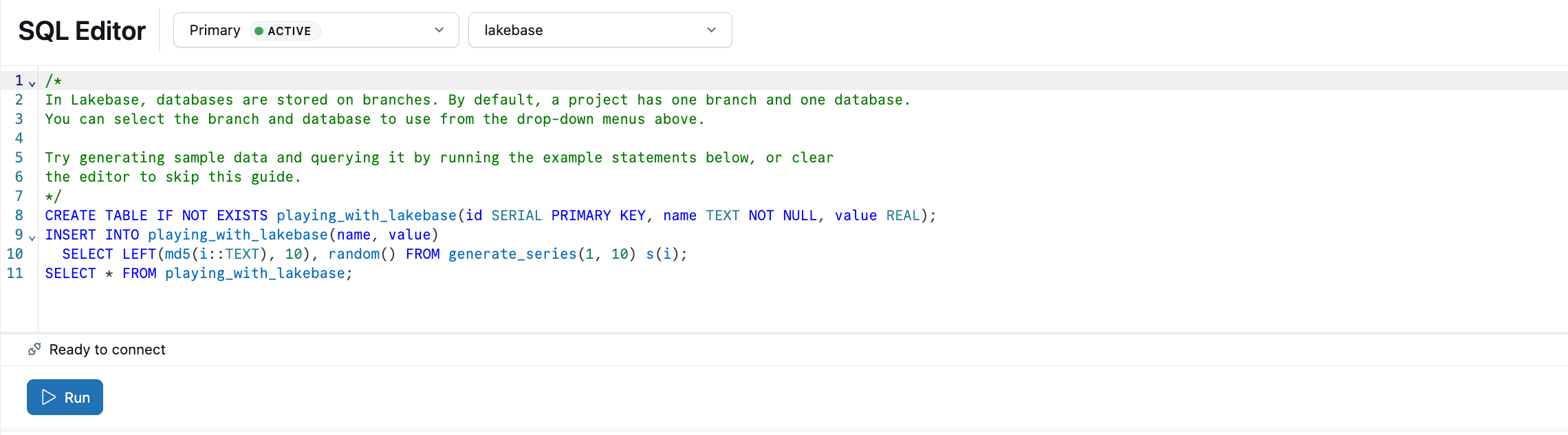

L'editor SQL di Lakebase viene fornito precaricato con SQL di esempio. Nel progetto selezionare il ramo di produzione , aprire l'editor SQL ed eseguire le istruzioni fornite per creare una playing_with_lakebase tabella e inserire dati di esempio.

Altre informazioni: Editor SQL | Editor tabelle | Client Postgres

Passaggio 4: Eseguire la registrazione nel catalogo unity

Il database Lakebase è in esecuzione, ma è invisibile al resto della piattaforma Databricks fino a quando non viene registrato in Unity Catalog. Dopo la registrazione, è possibile eseguire query sulle tabelle Lakebase da Databricks SQL, unire i dati operativi con l'analisi lakehouse e applicare la governance unificata.

In Esplora cataloghi, crea un nuovo catalogo con Lakebase Autoscaling come tipo, puntando al ramo del production e al database del databricks_postgres progetto.

È ora possibile eseguire query da un'istanza di SQL Warehouse:

SELECT * FROM lakebase_catalog.public.playing_with_lakebase;

Altre informazioni: Eseguire la registrazione nel catalogo unity

Passaggio 5: Gestire i dati lakehouse nell'app

Le tabelle sincronizzate portano dati analitici da Unity Catalog nel database Lakebase in modo che le applicazioni possano eseguirne query con letture transazionali a bassa latenza. Creare una tabella del catalogo Unity di esempio e quindi sincronizzarla con Lakebase.

Nel SQL Warehouse o notebook, crea una tabella di origine:

CREATE TABLE main.default.user_segments AS

SELECT * FROM VALUES

(1001, 'premium', 2500.00, 'high'),

(1002, 'standard', 450.00, 'medium'),

(1003, 'premium', 3200.00, 'high'),

(1004, 'basic', 120.00, 'low')

AS segments(user_id, tier, lifetime_value, engagement);

Sincronizzare ora questa tabella in Lakebase. In Esplora Cataloghi, crea una tabella sincronizzata, destinata al database del progetto user_segments, da con la modalità databricks_postgres. La modalità snapshot copia i dati una sola volta. Per gli aggiornamenti continui, usare la modalità attivata o continua.

Al termine della sincronizzazione, i dati sono disponibili in Lakebase come default.user_segments_synced. Eseguirne una query nell'editor SQL di Lakebase:

SELECT * FROM "default".user_segments_synced WHERE engagement = 'high';

Annotazioni

default deve essere racchiusa tra virgolette perché si tratta di una parola chiave riservata postgreSQL. Lo schema della tabella sincronizzata eredita il nome dello schema del catalogo Unity, quindi se lo schema è denominato default, è necessario specificarlo sempre nelle query. Le virgolette relative ad altri identificatori sono facoltative.

Le tue analisi lakehouse ora sono pronte per essere servite dal tuo database transazionale.

Ulteriori informazioni: Tabelle sincronizzate | Modalità di sincronizzazione | Mappatura dei tipi di dati

Passaggi successivi

- Crea un'app di Databricks:Esercitazione | App esterne

- Sviluppare con i branch: Esercitazionesullo sviluppo basato sui branch

- Imposta il tuo team:Concedi l'accesso al progetto e al database

- Esplora la piattaforma:Concetti principali | Panoramica dei progetti | Tutti i tutorial