Hinweis

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, sich anzumelden oder das Verzeichnis zu wechseln.

Für den Zugriff auf diese Seite ist eine Autorisierung erforderlich. Sie können versuchen, das Verzeichnis zu wechseln.

Von Bedeutung

Dieses Feature befindet sich in der Betaversion. Arbeitsbereichsadministratoren können den Zugriff auf dieses Feature über die Vorschauseite steuern. Siehe Manage Azure Databricks Previews.

Mosaik AI Vector Search bietet integrierte Bewertung der Abrufqualität, die die Relevanz verschiedener Suchstrategien für Ihre Daten misst und vergleicht. Sie können auswertungsabfragen automatisch aus Ihren Dokumenten generieren, mehrere Abrufstrategien ausführen und einen detaillierten Bericht erstellen.

Anforderungen

Ein verwalteter Delta-Sync-Vektorsuchindex. Siehe Erstellen von Vektorsuchendpunkten und Indizes.

Erlaubnisse

Der Auswertungsauftrag und das Ergebnisdashboard erben Unity-Katalogberechtigungen aus dem Vektorsuchindex. Jeder Benutzer mit Abfragezugriff auf den Index kann eine Auswertungsausführung starten und das Ergebnisdashboard anzeigen. Der Benutzer, der die Auswertung startet, ist der Besitzer des Auftrags, nicht der Besitzer des Indexes.

Funktionsweise der Qualitätsauswertung von Vektorsuchvorgängen

Die Auswertung führt eine vierstufige Pipeline für Ihre Daten aus:

- Generieren von Abfragen: Das System entnimmt Dokumente aus Ihrer Quelltabelle und verwendet ein LLM, um realistische Suchabfragen zu generieren. Es generiert eine Mischung aus Abfragen in natürlicher Sprache und Stichwortabfragen.

- Suche über verschiedene Strategien hinweg: Jede generierte Abfrage wird mittels mehrerer Abrufstrategien in Ihrem Index durchgeführt, einschließlich ANN, Hybrid und Volltext. Jede Strategie wird auch mit und ohne den Reranker ausgewertet. Bei diesem Ansatz werden Strategien nebeneinander im gleichen Abfragesatz verglichen. Weitere Informationen zu jeder Abrufstrategie finden Sie unter Abrufalgorithmen.

- Bewertungsrelevanz: Ein LLM-Richter wertet jedes Abfrage- und abgerufene Dokumentpaar auf einer 4-Punkt-Relevanzskala aus.

- Berechnen von Metriken und Analysieren: Das System berechnet Abrufqualitätsmetriken mit Konfidenzintervallen. Die Ergebnisse werden beibehalten, damit Sie sie später anzeigen oder die Auswertungsläufe vergleichen können.

Starten einer Auswertung der Abrufqualität

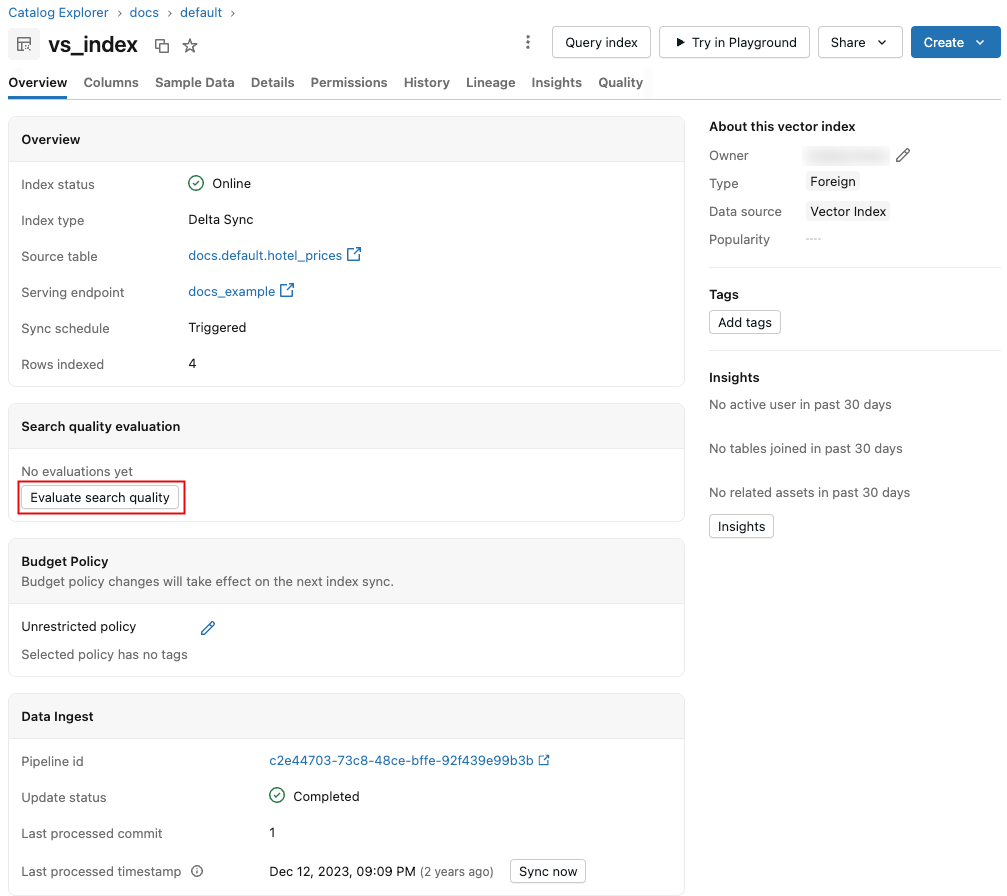

Klicken Sie zum Starten des Prozesses auf der Vektorsuchindexseite auf " Suchqualität auswerten ". Es ist keine Konfiguration erforderlich, da Standardwerte basierend auf Ihren Indexmetadaten vorab aufgefüllt werden.

Wenn die Ausführung abgeschlossen ist, klicken Sie auf "Ergebnisse anzeigen ", um das Ergebnisdashboard anzuzeigen. Eine Übersicht über das Dashboard finden Sie im Dashboard "Ergebnisse".

Wenn Sie eine neue Auswertung jederzeit initiieren möchten, klicken Sie auf " Neue Auswertung starten".

Ergebnisdashboard

Das Dashboard zeigt die Ergebnisse der Auswertungsläufe an. Verwenden Sie das Dropdownmenü "Ausführen auswählen", um die Ausführung auszuwählen, die angezeigt werden soll.

Am oberen Rand des Dashboards befinden sich drei Zusammenfassungsindikatoren: die beste DCG@10 Bewertung für alle Abfragetypen, den empfohlenen Abfragetyp, der sie erreicht hat, und die Anzahl der ausgewerteten Abfragen.

Lesen Sie, warum Databricks DCG@10 empfiehlt.

Unterhalb der Zusammenfassungsindikatoren zeigt das Dashboard ein Balkendiagramm an, das DCG@10 Bewertungen für jeden Abfragetyp mit und ohne Verwendung des Rerankers vergleicht. Neben dem Balkendiagramm befinden sich zwei Tabellen mit DCG@10 und durchschnittlicher Relevanz für jeden Abfragetyp, mit und ohne den Reranker.

Nachfolgend sehen Sie ein Liniendiagramm, das zeigt, wie sich die durchschnittliche Relevanz für die Ergebnispositionen für jeden Abfragetyp ändert.

Das Dashboard stellt außerdem die höchst- und niedrigstbewerteten Abfragen gemäß der durchschnittlichen Relevanzbewertung dar, eine Tabelle, die die Basis- und Rerankerleistung für jeden Abfragetyp vergleicht, eine Tabelle mit fehlgeschlagenen Abfragen (Abfragen, bei denen das Top-1-Ergebnis dabei eine Bewertung von 0 (irrelevant) erhielt), und ein Liniendiagramm, das eine ausgewählte Metrik im Laufe der Evaluationsdurchläufe nach Abfragemetrik anzeigt.

Relevanzbewertung

Die Bewertung der Abrufqualität nutzt ein LLM als Richter, um jede Abfrage und jedes abgerufene Dokument auf einer vierstufigen Relevanzskala zu bewerten.

| Ergebnis | Bezeichnung | Beschreibung | Beispiel |

|---|---|---|---|

| 3 | Hoch relevant | Dokument beantwortet die Abfrage direkt oder liefert genau die gesuchten Informationen. | Abfrage: "Wie kann ich den Bereich eines Rechtecks berechnen?" Im Dokument wird die Formel zur Berechnung von Länge × Breite erläutert. |

| 2 | Relevante | Das Dokument ist verwandt und stellt nützliche Informationen bereit, die Abfrage kann jedoch nicht vollständig beantwortet werden. | Abfrage: "Wo befindet sich die Routingnummer auf einem Scheck?" Das Dokument besagt "gedruckt am unteren Rand eines Schecks" (teilweise abgeschlossen) |

| 1 | Teilweise relevant | Dokument erwähnt das Thema, stellt aber keine nützlichen Informationen für die Abfrage bereit. | Abfrage: "Wie wird der Bereich eines Rechtecks berechnet?" Dokument behandelt die Fläche von Rechtecken nur in allgemeiner Form. |

| 0 | Nicht relevant | Das Dokument ist nicht mit der Abfrage verknüpft, oder die Dokumentsprache stimmt nicht mit der Abfragesprache überein. | Abfrage in Englisch Dokumentantworten richtig, aber in Französisch |

Im Vergleich zu einer binär relevanten/nicht relevanten Skala erfasst der bewertete Maßstab wichtige Unterscheidungen. Beispielsweise unterscheidet sich ein Dokument, das direkt eine Frage beantwortet (Punkt 3) von einem Dokument, das lediglich das Thema berührt (Punkt 1). Diese Granularität fließt durch die Metriken, insbesondere DCG, wodurch die Ergebnisse höherer Qualität stärker gewichtet werden.

Alle Metriken umfassen 95% Konfidenzintervalle, die pro Abfragewert berechnet werden, sodass Sie beurteilen können, ob Unterschiede zwischen Strategien statistisch sinnvoll sind.

Abrufmetriken

Am unteren Rand des Dashboards können Sie eine ausgewählte Metrik im Laufe der Zeit anzeigen. Wählen Sie die Metrik aus, die im Dropdownmenü "Metrik auswählen " angezeigt werden soll.

In diesem Abschnitt werden die verfügbaren Metriken beschrieben.

DCG@k – reduzierter kumulativer Gewinn

DCG@10 erfasst, wie relevant die Ergebnisse sind und wo sie in der Rangfolge angezeigt werden, wobei die vollständige Relevanzskala von 0 bis 3 verwendet wird. Databricks empfiehlt die Verwendung von DCG@10 als primäre Metrik für die Auswertung der Gesamtabrufqualität.

- Was es misst: Das Gesamtnutzen der Top-10-Ergebnisse, gewichtet nach Position. Höher bewertete Ergebnisse haben einen größeren Einfluss als niedriger bewertete Ergebnisse.

- Funktionsweise: Die Relevanzbewertung jedes Ergebnisses wird durch einen logarithmischen Abschlag basierend auf seiner Position gewichtet. Das erste Ergebnis trägt zur vollständigen Relevanz bei, während die Ergebnisse mit niedrigerer Rangfolge immer weniger beitragen.

- Bereich: 0 bis zum theoretischen Maximum, das in der folgenden Tabelle angezeigt wird. Höher ist besser.

Theoretisch maximale DCG-Werte, wenn jedes Ergebnis die Bewertung 3 erhält:

| k | Theoretische maximale DCG |

|---|---|

| 1 | 3.00 |

| 3 | 6.39 |

| 5 | 8.85 |

| 10 | 13.63 |

| 20 | 21.12 |

Um diese Zahlen perspektivisch zu setzen: Wenn alle 10 Ergebnisse eine Relevanz von 2 haben (auf einer Skala von 0 bis 3), DCG@10 13,6 beträgt. In diesem Szenario ist ein 1-Punkt-DCG@10 Gewinn eine sehr signifikante (+7% relative) Verbesserung. Sie können sich dies als ungefähr ein Ergebnis auf der Seite vorstellen, das merklich besser wird, gewichtet in Richtung oben.

NDCG@k - Normalisierter rabattierter kumulierter Gewinn

- Was es misst: Wie gut Ergebnisse relativ zur bestmöglichen Sortierung sortiert werden. NDCG normalisiert die DCG, indem sie durch die ideale DCG dividiert wird (die DCG, wenn die Ergebnisse in absteigender Reihenfolge ihrer Relevanz sortiert wären).

- Bereich: 0 bis 1. Eine Punktzahl von 1,0 bedeutet, dass Ergebnisse in perfekter Reihenfolge sind.

- Wann sie verwenden sollten: Wenn Sie wissen möchten, ob das System die Ergebnisse richtig bewertt, unabhängig von der Gesamtanzahl der verfügbaren relevanten Dokumente. Lesen Sie , warum DCG@10 die empfohlene primäre Metrik für einen detaillierten Vergleich ist.

Recall@k

- Was es misst: Der Anteil der bekannten relevanten Dokumente, die in den top-k-Ergebnissen angezeigt werden.

- Bereich: 0 bis 1. Eine Bewertung von 1,0 bedeutet, dass alle bekannten relevanten Dokumente abgerufen wurden.

- Wann verwendet werden soll: Wenn die Vollständigkeit von Bedeutung ist, zum Beispiel in RAG-Anwendungen, bei denen ein relevantes Dokument fehlt und dies dazu führt, dass das LLM eine unvollständige Antwort erzeugt.

Precision@k

- Was sie misst: Der Bruchteil der top-k-Ergebnisse, die relevant sind (Relevanzbewertung >= 2).

- Bereich: 0 bis 1. Eine Punktzahl von 1,0 bedeutet, dass jedes Ergebnis im top k relevant ist.

- Wann sie verwenden sollten: Wenn die Ergebnisqualität wichtiger als die Vollständigkeit ist, z. B. in Suchoberflächen, bei denen irrelevante Ergebnisse sich negativ auf die Benutzervertrauensstellung auswirken können.

Durchschnittliche Relevanzbewertung

- Was es misst: Der von LLM beurteilte durchschnittliche Relevanzwert für alle Abfrage-Ergebnis-Paare.

- Bereich: 0 bis 3. Höher ist besser.

- Wann verwendet werden soll: Als schnelle Qualitätsmomentaufnahme.

Relevanzverteilung

-

Was sie misst: Der Prozentsatz der Ergebnisse in jeder Relevanzkategorie:

- Hoch relevante %: Ergebnisbewertung 3 (direkte Antworten).

- Relevant+ %: Ergebnisse mit einer Bewertung von 2 oder höher (nützlich).

- Nicht relevant %: Ergebnisbewertung 0 oder 1 (nicht nützlich).

- Wann sie verwendet werden sollten: Um die Form der Qualitätsverteilung zu verstehen. Zwei Strategien können den gleichen Durchschnittswert aufweisen, aber sehr unterschiedliche Verteilungen. Eine Bimodalverteilung (viele 3 und viele 0s) könnte z. B. vorschlagen, dass ein Abfragemuster nicht gut abgerufen wird und Aufmerksamkeit benötigt.

MRR — Mean Reciprocal Rank (Mittelwert der reziproken Rangfolge)

- Was es misst: Wie schnell Benutzer das erste relevante Ergebnis finden. MRR ist der Mittelwert von 1/Rang für Abfragen, wobei der Rang die Position des ersten relevanten Ergebnisses ist (Punkt >= 2).

- Bereich: 0 bis 1. Eine Punktzahl von 1,0 bedeutet, dass das erste Ergebnis immer relevant ist.

- Wann dies zu verwenden ist: Wenn das oberste Ergebnis am wichtigsten ist, z. B. in Fragebeantwortungssystemen.

MAP@k – Mittlere durchschnittliche Präzision

- Was es misst: Die Qualität der Rangfolge über alle relevanten Ergebnisse hinweg, nicht nur die erste. MAP berechnet die Genauigkeit an der Position jedes relevanten Ergebnisses und berechnet dann die Mittelwerte.

- Bereich: 0 bis 1. Höhere Werte deuten darauf hin, dass relevante Dokumente am oberen Rand konsistent bewertet werden.

- Wann sie verwenden sollten: Wenn Sie eine einzelne Zahl benötigen, die die Gesamtbewertungsqualität für alle relevanten Dokumente erfasst.

Warum DCG@10 die empfohlene primäre Metrik ist

DCG@10 bietet für die meisten Anwendungen das umfassendste Bild der Abrufqualität:

- Bewertete Relevanz erfasst Nuancen: Binäre Metriken wie Genauigkeit behandeln alle relevanten Dokumente gleichermaßen. Ein Dokument, das die Abfrage perfekt beantwortet (Punkt 3) zählt genauso wie ein Dokument, das das Thema vage erwähnt (Punkt 1). DCG verwendet die vollständige Relevanzskala von 0 bis 3, sodass ein Ergebnis, das 3 bewertet wurde, wesentlich mehr als ein Ergebnis von 1 beiträgt.

- Die Position ist wichtig: Die Benutzer betrachten zuerst die wichtigsten Ergebnisse. DCG wendet einen logarithmischen Rabatt an, sodass die Ergebnisse an Position 1 viel mehr als Ergebnisse an Position 10 zählen. Das erste Ergebnis trägt zu seiner vollständigen Relevanzbewertung bei, während der Beitrag des 10. Ergebnisses durch log²(11) ≈ 3,46 dividiert wird.

- Der absolute Nutzwert verdeutlicht, was normalisierte Metriken übersehen: Betrachten Sie das in der folgenden Tabelle gezeigte Beispiel. Beide Resultsets erzielen eine perfekte NDCG von 1,00, da jedes eine ideale absteigende Reihenfolge der Ergebnisse hat. Ergebnissatz B liefert jedoch fast zweimal den Gesamtwert (DCG 8,02 vs 4,26), da jedes Ergebnis nützlich ist. NDCG kann nicht zwischen "perfekte Rangfolge von 2 guten Ergebnissen unter 3 irrelevanten" und "perfekte Rangfolge von 5 guten Ergebnissen" unterscheiden. DCG beantwortet die Frage: "Wie viel nützliche Informationen hat der Benutzer tatsächlich erhalten?"

Weitere Informationen zu DCG und NDCG finden Sie unter Reduzierter kumulativer Gewinn.

| Ergebnisse | Position 1 | Position 2 | Position 3 | Position 4 | Position 5 | NDCG@5 | DCG@5 |

|---|---|---|---|---|---|---|---|

| Ergebnismenge A | 3 | 2 | 0 | 0 | 0 | 1.00 | 4,26 |

| Ergebnismenge B | 3 | 3 | 3 | 2 | 2 | 1.00 | 8.02 |

Keine einzelne Metrik erzählt die gesamte Geschichte. Verwenden Sie die vollständige Metriksuite für ein vollständiges Bild, und wählen Sie die Metrik aus, die den Qualitätsanforderungen Ihrer Anwendung am besten entspricht.

Häufige Szenarien

In der folgenden Tabelle werden allgemeine Auswertungsergebnismuster, ihre Bedeutung und ihre Adressierung erläutert:

| Schema | Bedeutung | Vorgeschlagene Maßnahme |

|---|---|---|

| Hybrid deutlich besser als ANN | Abfragen profitieren vom Stichwortabgleich. | Verwenden Sie die Hybridsuche in der Produktion. |

| ANN ungefähr gleich Hybrid | Schlüsselwörter sind kein Mehrwert für Ihre Daten. | Beide Strategie funktioniert. ANN ist einfacher. |

| Volltext deutlich besser als ANN | Einbettungen erfassen Ihre Domäne möglicherweise nicht gut. | Erwägen Sie die Feinabstimmung Ihres Einbettungsmodells oder die Verwendung der Volltextsuche. |

| Reranker verbessert Metriken erheblich | Cross-Encoder bietet eine aussagekräftige Qualitätssteigerung. | Aktivieren Sie Reranker, wenn das Latenzbudget es zulässt. |

| Breite Konfidenzintervalle | Nicht genügend Abfragen für einen zuverlässigen Vergleich. | Erhöhen Sie die Anzahl der Auswertungsabfragen. |

| Alle Strategien punkten niedrig | Datenqualitäts- oder Relevanzprobleme. | Eine schrittweise Anleitung zur Verbesserung der Abrufqualität finden Sie im Leitfaden zur Vektorsuche . |