Bemærk

Adgang til denne side kræver godkendelse. Du kan prøve at logge på eller ændre mapper.

Adgang til denne side kræver godkendelse. Du kan prøve at ændre mapper.

Microsoft Fabric Data Engineering- og Data Science-oplevelser fungerer på en fuldt administreret Spark-beregningsplatform. Som standard deler alle Spark-jobs i et arbejdsområde de samme pool- og ressourceindstillinger, men forskellige arbejdsbelastninger har ofte forskellige krav. En letvægts datatransformation behøver ikke samme driverhukommelse som et storskala maskinlæringsjob.

Fabric-miljøer lader dig tilpasse Spark-beregningskonfiguration pr. arbejdsbyrde, så hver notebook- eller Spark-jobdefinition kan køre med den rette runtime-version, pool og driver/executor-størrelse uden at ændre arbejdsområde-standardindstillinger.

Konfigurer arbejdsområde-niveau compute-indstillinger

Workspace-administratorer styrer, om miljøelementer kan tilsidesætte arbejdsområdets standardkonfiguration. Hvis du holder tilpasning på elementniveau deaktiveret, sikrer du ensartet ressourceforbrug i hele arbejdsområdet. At aktivere det giver medlemmer og bidragydere fleksibilitet til at tune compute til individuelle arbejdsbelastninger.

I din browser skal du gå til dit Fabric-arbejdsområde i Fabric-portalen.

Vælg indstillinger for arbejdsområde.

Vælg Data Engineering/Science, og vælg derefter Spark-indstillinger.

Vælg fanen Pool .

Slå tilpas-konfigurationer for genstande til Tændt.

Når denne toggle er slået til, kan medlemmer og bidragydere ændre sessionsniveau-beregningskonfigurationer i et Fabric-miljø. Når den er slået fra, er Compute-sektionen i miljøobjekter deaktiveret, og alle Spark-jobs bruger arbejdsområdets standardpool.

Vælg Save.

Konfigurer beregning i et miljø

Når en workspace-administrator aktiverer tilpasning på item-niveau, kan du konfigurere compute-indstillinger inde i et miljøobjekt. Dette inkluderer valg af en Spark-runtime, valg af en pool og justering af driver- og executor-ressourcer.

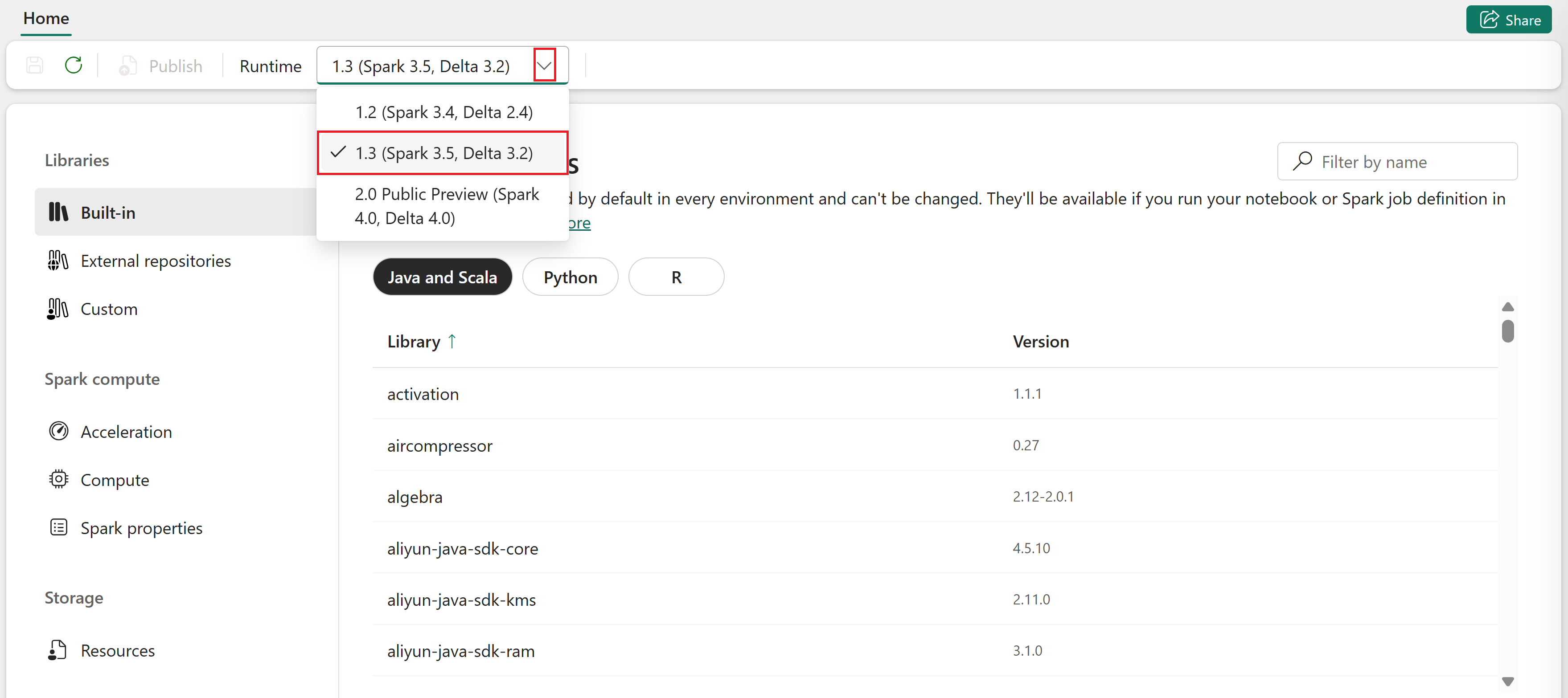

Vælg en Spark-runtime

Hver Spark-runtime har sine egne standardindstillinger og forudinstallerede pakker.

Vigtigt!

- Ændringer i runtime træder først i kraft, når du gemmer og offentliggør miljøet.

- Hvis eksisterende biblioteker eller compute-indstillinger ikke er kompatible med den valgte runtime, fejler publiceringen. Fjern eller opdater de inkompatible indstillinger, og publicér så igen.

- For trin-for-trin publiceringsinstruktioner, se Save and publish changes.

Vælg en pulje og juster beregningsegenskaberne

Åbn miljøet og gå til Compute-sektionen .

Under Environment pool vælger du startpoolen eller en brugerdefineret pool oprettet af din workspace-administrator.

Brug dropdown-menuerne på Compute-siden til at konfigurere sessionsniveau Spark-egenskaber for den valgte pool. Tilgængelige værdier afhænger af poolens nodestørrelse.

Ejendomme omfatter:

- Spark-driverkerner – Antal kerner tildelt Spark-driveren.

- Spark-driverhukommelse – Mængden af hukommelse, der er tildelt Spark-driveren.

- Spark-eksekveringkerner – Antal kerner tildelt hver eksekver.

- Spark executor-hukommelse – Mængden af hukommelse, der tildeles hver eksekver.

For detaljer om tilgængelige poolstørrelser og ressourcebegrænsninger, se Spark compute in Fabric.

Bemærkning

Spark-egenskaber sat gennem spark.conf.set kontrolapplikationsniveau-parametre og er ikke relateret til de miljøberegningsindstillinger, der er beskrevet her.